ما وراء الصورة: كيف تتحقق من فيديوهات الحرب في 2026؟

في حروب عام 2026، بات التحقق من المحتوى الإعلامي أكثر تعقيداً من أي وقتٍ مضى، مع انتشار تقنياتٍ مثل التزييف العميق، واستخدام أدوات الذكاء الاصطناعي لتوليد مشاهدٍ واقعية يصعب تمييزها عن الحقيقة، بهدف الترويج لتلك الرواية أو دعم ذاك السيناريو.

وفي السياق، توضح المدرّبة وخبيرة تدقيق المعلومات جويس حنّا في حديث الى "النهار" أن هذا التحول فرض واقعاً جديداً على الصحافيين والمستخدمين على حدٍ سواء، مشيرة إلى أن اكتشاف الفيديوهات المضللة أصبح أكثر صعوبةً مع تطور الأدوات. وتشير إلى أن الحرب التي اندلعت بعد 7 أكتوبر شهدت انتشاراً واسعاً لمحتوى مُولّدٍ باستخدام الذكاء الاصطناعي.

وتقول: "في السابق، كانت هناك مؤشرات بديهية تكشف التلاعب، أما اليوم فقد تراجعت هذه العلامات، ما يتطلب تحليلاً أكثر عمقاً، وأحياناً الاستعانة بخبراءٍ متخصصين".

وهنا نجد أن السؤال لم يعد "هل الفيديو حقيقي؟" فحسب، بل "كيف أُثبت ذلك من عدمه؟".

مؤشرات أولية: ما الذي يجب التنبه إليه؟

تشير حنّا إلى أن الفيديوهات المضلّلة لا تخلو من إشارات، لكنها أصبحت أدقّ وأصعب رصداً. ومن أبرزها:

-غياب الاتساق داخل المشهد (مثل عناصر لا تتفاعل بشكل طبيعي).

-مبالغة غير منطقية في حجم الانفجارات أو الأحداث.

-اختفاء أو ظهور مفاجئ لعناصرٍ متحركة.

-إضطرابات شكلية أو ضبابية غير مبررة.

لكنها تحذّر في الوقت نفسه من أن بعض هذه المؤشرات قد يظهر أيضاً في فيديوهات حقيقية، ما يزيد من تعقيد عملية التحقق.

دليل عملي للتحقق من المحتوى

رغم تطور تقنيات التضليل، تؤكد حنّا أن المنهجيات الأساسية لا تزال الأكثر موثوقية، ويمكن تلخيصها بالخطوات الآتية:

1. المصدر

أول خطوة هي معرفة من نشر الفيديو. هل هو حساب رسمي؟ صحافي موثوق به؟ أم حساب حديث؟ لكن حتى الحسابات "الموثوقة" قد تقع في فخّ التضليل، لذا لا يكفي الاعتماد على المصدر وحده.

2. التفاصيل البصرية

الفيديوهات المضللة غالباً ما تحتوي على إشاراتٍ صغيرة تكشفها، مثل:

-ظلالٍ غير منطقية.

-أصوات لا تتطابق مع حركة الشفاه.

-تشوهات في الوجوه أو الخلفيات.

3. البحث العكسي

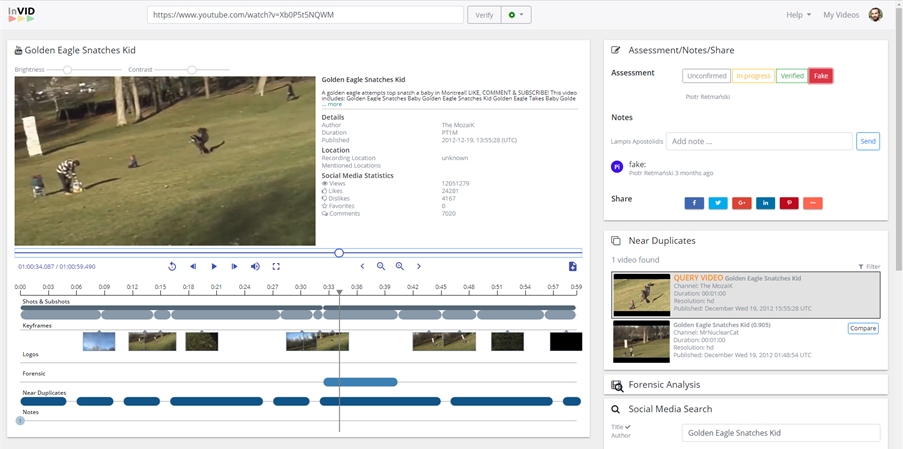

يمكن استخراج لقطاتٍ من الفيديو والبحث عنها عبر أدواتٍ مثل Google Lens أو InVID. هذه الطريقة تساعد في كشف ما إذا كان الفيديو قديماً أو أُعيد استخدامه في سياق مختلف.

4. الموقع الجغرافي (Geolocation)

قارن ما يظهر في الفيديو مع خرائطٍ وصور أقمارٍ اصطناعية عبر Google Earth. المباني، الجبال، اللافتات، وحتى شكل الطرق، كلها أدلة يمكن أن تؤكد موقع التصوير أو تنفيه.

5. التوقيت

أحياناً يكون الفيديو حقيقياً، لكنه ليس من الحدث الحالي، وهنا يمكن مراجعة:

-حالة الطقس

-الإضاءة (نهار/ليل)

-ملابس الأشخاص

وقارنها مع توقيت الحدث المزعوم.

6. الصوت

هل يتطابق مع المشهد؟ هل هناك قصّ أو تركيب؟ في بعض الحالات، يتم استخدام صوت حقيقي فوق فيديو مزيف، أو العكس.

7. مصادر أخرى

لا تعتمد على فيديو واحد. إبحث عن تغطياتٍ من وسائل إعلامٍ مختلفة أو شهودٍ عيان. إذا لم يظهر الحدث نفسه من زوايا متعددة، فهذا يستدعي الشك.

8. سلوك الانتشار

الفيديوهات المضلّلة تنتشر غالباً بسرعة كبيرة وبالنصوص نفسها. إذا لاحظت انتشاراً متزامناً عبر حساباتٍ غير معروفة، فقد يكون ذلك جزءاً من حملة منسقة.

هل يمكن الوثوق بأدوات الذكاء الاصطناعي للتحقيق؟

تحذر حنّا من الاعتماد على أدوات الذكاء الاصطناعي نفسها لكشف المحتوى المُولّد به، مشيرةً إلى أنها لا تزال غير دقيقةٍ بالكامل، وقد تعطي نتائج مضللة في بعض الأحيان.

وتؤكد أن المشكلة لا تقتصر على التكنولوجيا فحسب، بل تشمل سلوك المستخدمين أيضاً. فبعضهم ينشر المحتوى المضلّل سعياً وراء التفاعل، فيما يشاركه آخرون بدافع الخوف أو التأثر النفسي بأحداث الحرب، ما يسرّع انتشاره.

مع تطور أدوات الذكاء الاصطناعي، لم يعد التلاعب بالفيديو يتطلب خبرةً تقنية كبيرة. اليوم، يمكن لأي شخص تقريباً إنتاج محتوى مضلّلاً خلال دقائق. لكن في المقابل، تطورت أيضاً أدوات التحقق، وأصبحت لدى الصحافيين والباحثين ترسانة من الأدوات لمواجهة هذا النوع من التضليل.

في زمن يمكن فيه "تصنيع الواقع والرواية والسيناريو"، تبقى المهارة الأهم هي: عدم تصديق كل ما نراه.

واتساب

واتساب

تویتر

تویتر

فيسبوك

فيسبوك

يوتيوب

يوتيوب

انستغرام

انستغرام

نبض

نبض

ثريدز

ثريدز

مسنجر

مسنجر

بريد إلكتروني

بريد إلكتروني

الطباعة

الطباعة